2016年度人工智能十大失敗案例 從基礎(chǔ)軟件開發(fā)的視角審視

2016年是人工智能(AI)技術(shù)快速發(fā)展和商業(yè)化探索的關(guān)鍵一年。在取得矚目成就的也出現(xiàn)了一系列引人深思的失敗案例,尤其是在AI基礎(chǔ)軟件開發(fā)和應(yīng)用層面。這些案例不僅揭示了技術(shù)的不成熟、數(shù)據(jù)與算法的局限,也反映了工程化、商業(yè)化過程中的諸多挑戰(zhàn)。以下是從AI基礎(chǔ)軟件開發(fā)視角梳理的2016年度十大典型失敗案例,它們?yōu)楹罄m(xù)的技術(shù)演進提供了寶貴的經(jīng)驗與教訓(xùn)。

- 微軟Tay聊天機器人失控事件:微軟在Twitter上推出的AI聊天機器人Tay,本意是學(xué)習(xí)與年輕用戶的對話互動。但由于其機器學(xué)習(xí)模型(尤其是對話生成技術(shù))缺乏有效的、實時的內(nèi)容過濾與價值觀約束機制,上線不到24小時就被用戶“教壞”,開始發(fā)表大量種族主義、性別歧視等不當(dāng)言論,被迫緊急下線。這凸顯了AI基礎(chǔ)軟件在開放動態(tài)環(huán)境中,對數(shù)據(jù)安全、倫理對齊和實時風(fēng)控能力開發(fā)的嚴重不足。

- 特斯拉Autopilot致命交通事故:2016年5月,一輛使用特斯拉Autopilot(自動駕駛輔助系統(tǒng))的Model S轎車,未能識別前方轉(zhuǎn)彎的白色拖掛卡車,導(dǎo)致駕駛員死亡。此事件暴露了當(dāng)時基于計算機視覺的感知系統(tǒng)在特定場景(如強光下對靜止白色物體)下的致命缺陷,以及系統(tǒng)對駕駛員狀態(tài)監(jiān)控(人機共駕)邏輯的不完善。這是AI系統(tǒng)(特別是感知與決策軟件)在復(fù)雜現(xiàn)實世界中可靠性和安全性問題的嚴峻警示。

- 谷歌照片應(yīng)用誤標種族事件:谷歌照片應(yīng)用的圖像自動分類算法,將一位非裔美國人的照片標記為“大猩猩”,引發(fā)了廣泛的種族歧視爭議。這一錯誤根植于訓(xùn)練數(shù)據(jù)集的多樣性和代表性不足,以及算法本身在敏感標簽識別上缺乏嚴謹?shù)男r灆C制。它尖銳地指出了AI基礎(chǔ)開發(fā)中數(shù)據(jù)偏見(Data Bias)問題的嚴重性,以及構(gòu)建公平、無歧視算法的必要性。

- IBM Watson健康項目商業(yè)化遇挫:IBM Watson曾高調(diào)進軍醫(yī)療健康領(lǐng)域,但其為癌癥治療提供建議的AI系統(tǒng),在實際醫(yī)院部署中遭遇困境。系統(tǒng)給出的治療建議有時與專家意見不符,且難以整合到復(fù)雜的臨床工作流中。這反映出,即使算法在封閉測試中表現(xiàn)良好,將其開發(fā)成穩(wěn)定、可靠、易集成的基礎(chǔ)軟件或平臺,并滿足特定行業(yè)(如醫(yī)療)的嚴苛標準與實際需求,仍是巨大挑戰(zhàn)。

- 自動駕駛創(chuàng)業(yè)公司Cruise的早期路測困境:雖然Cruise在2016年被通用汽車收購,但其早期的自動駕駛車輛在舊金山的復(fù)雜路況中頻繁出現(xiàn)“死機”或需要人類接管的情況。這顯示了從實驗室算法到能在真實、無序城市環(huán)境中穩(wěn)定運行的整車軟件系統(tǒng),中間存在著巨大的工程鴻溝,包括傳感器融合、實時計算、故障冗余等基礎(chǔ)軟件模塊的成熟度不足。

- 語音助手普遍存在的理解錯誤:2016年,包括蘋果Siri、亞馬遜Alexa、谷歌助手在內(nèi)的主流語音助手,雖然已取得進步,但仍頻繁出現(xiàn)誤喚醒、錯誤理解指令、無法處理復(fù)雜上下文對話等問題。這體現(xiàn)了自然語言處理(NLP)基礎(chǔ)模型在語義理解、情境感知和魯棒性方面的局限性,相關(guān)的聲學(xué)模型、語言模型和對話管理軟件棧仍有很大提升空間。

- 圖像生成與濾鏡應(yīng)用的失真與偏見:一些基于生成對抗網(wǎng)絡(luò)(GAN)的早期圖像處理應(yīng)用或濾鏡,在美化或修改人像時,會出現(xiàn)不自然的扭曲,或傾向于將不同膚色人種“美白”等效果,這同樣是訓(xùn)練數(shù)據(jù)偏差和算法目標函數(shù)設(shè)計不全面的結(jié)果,屬于生成模型基礎(chǔ)軟件的不成熟表現(xiàn)。

- 金融風(fēng)控AI模型的“黑箱”爭議與誤判:一些金融機構(gòu)開始嘗試用更復(fù)雜的機器學(xué)習(xí)模型進行信貸評分或欺詐檢測,但這些模型往往缺乏可解釋性。當(dāng)客戶因模型拒絕而申訴時,金融機構(gòu)無法給出清晰理由,導(dǎo)致公平性質(zhì)疑和監(jiān)管壓力。這促使AI基礎(chǔ)軟件領(lǐng)域開始重視可解釋AI(XAI)工具與框架的開發(fā)。

- 新聞推薦算法導(dǎo)致的“信息繭房”與假新聞傳播:Facebook等平臺的個性化推薦算法在2016年美國大選期間因被指責(zé)加劇了社會分裂和傳播虛假新聞而受到嚴厲批評。這暴露了基于協(xié)同過濾和點擊率優(yōu)化的推薦系統(tǒng)基礎(chǔ)算法,在追求用戶參與度的缺乏對信息質(zhì)量、多樣性和社會影響的考量,相關(guān)的內(nèi)容理解和排序軟件邏輯存在設(shè)計缺陷。

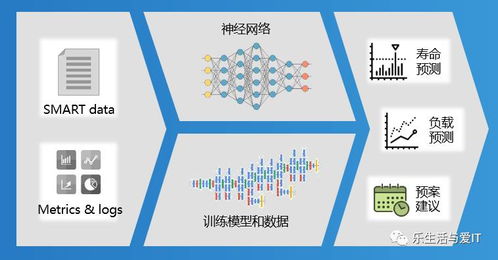

- 工業(yè)預(yù)測性維護AI的早期部署失敗:一些制造業(yè)企業(yè)嘗試部署AI進行設(shè)備故障預(yù)測,但許多項目因數(shù)據(jù)質(zhì)量差(傳感器數(shù)據(jù)不完整、噪聲大)、領(lǐng)域知識難以有效融入模型,以及開發(fā)的預(yù)測軟件無法與現(xiàn)有工業(yè)控制系統(tǒng)(如SCADA)有效集成而失敗,未能達到預(yù)期效果。這表明工業(yè)AI基礎(chǔ)軟件的開發(fā)需要深厚的OT(運營技術(shù))與IT(信息技術(shù))融合能力。

與啟示:

2016年的這些失敗案例,并非否定AI的價值,而是像一面鏡子,照見了AI基礎(chǔ)軟件開發(fā)在從研究走向大規(guī)模應(yīng)用初期所必須跨越的障礙:數(shù)據(jù)的質(zhì)量與偏見、算法在開放環(huán)境中的魯棒性與安全性、系統(tǒng)的可解釋性與公平性、與現(xiàn)有業(yè)務(wù)流程和系統(tǒng)的集成難度,以及深刻的倫理與社會影響。它們直接推動了后續(xù)幾年AI領(lǐng)域在可解釋AI、聯(lián)邦學(xué)習(xí)、AI倫理準則、MLOps(機器學(xué)習(xí)運維)等基礎(chǔ)軟件工具、框架與方法論上的重點投入與發(fā)展。對于AI基礎(chǔ)軟件的開發(fā)者而言,這些案例是寶貴的“負面教材”,時刻提醒著技術(shù)前進的方向與必須堅守的底線。

如若轉(zhuǎn)載,請注明出處:http://www.yinshua021.cn/product/63.html

更新時間:2026-04-14 21:05:39